Wahlkampf im Feed?

Wie TikTok mit parteipolitischen Inhalten im Vorfeld der Bundestagswahl 2025 umgeht

Wie TikTok mit parteipolitischen Inhalten im Vorfeld der Bundestagswahl 2025 umgeht

Anna Katzy-Reinshagen, Martin Degeling, Solveig Barth, Mauritius Dorn

22.02.2025

Im Fokus der Kurzanalyse steht die Frage, welche Risiken mit der algorithmischen Verbreitung parteipolitischer Inhalte auf TikTok im Vorfeld der Bundestagswahl am 23. Februar 2025 verbunden sind. Um zu ergründen, inwiefern eine „asymmetrische Amplifizierung” parteipolitischer Inhalte vorliegt, wurden insbesondere die Reihenfolge der ausgespielten parteipolitischen Inhalte im Für-dich-Feed und die Klassifizierung von parteipolitischen Inhalten durch Diversifizierungslabels untersucht. Zusätzlich wurde die Kennzeichnung von wahlbezogenen Videos analysiert. Die Analyse ist Teil des von der Stiftung Mercator geförderten ISD-Projektes AHEAD.tech, das eine verfeinerte Methode zur Erforschung systemischer Risiken für Wahlen im Kontext des Digital Services Act (DSA) entwickelt und darauf basierend zielgerichtete Minderungsmaßnahmen erarbeitet.

Online-Plattformen sind im Bundestagswahlkampf 2025 von großer Bedeutung. Zu den für die Parteien wichtigsten Online-Plattformen gehört, spätestens seit dem letzten Jahr, TikTok. Insbesondere in der Zielgruppe der jüngeren Menschen zwischen 16 und 30 Jahren ist dies eine der meistgenutzten Online-Plattformen. Anders als bei den meisten anderen sehr großen Online-Plattformen dürfen Parteien auf TikTok keine Werbeanzeigen schalten oder sich Reichweite erkaufen. Um Wähler*innen zu erreichen, müssen die Kandidat*innen und Parteien deshalb andere Wege gehen. Dabei steht der Empfehlungsalgorithmus besonders im Fokus.

Eine erste retrospektive Analyse von AHEAD.tech zum TikTok-Empfehlungssystem im Kontext der Landtagswahl Brandenburg 2024 fand heraus, dass die politische Ausrichtung angelegter Nutzeraccounts die Diversität der ausgespielten parteipolitischen Inhalte beeinflusst. Dennoch konnte die spezifische Rolle des Für-dich-Feeds für das Anzeigen solcher Inhalte oder die Durchsetzung von TikToks Transparenzmaßnahmen wie der Kennzeichnung von wahlbezogenen Inhalten nicht geklärt werden. Anschließend an die bisherige Forschung untersucht die vorliegende Kurzanalyse daher nicht nur, in welcher Reihenfolge und in welchem Umfang parteipolitische Inhalte in den Feeds unterschiedlicher Personas ausgespielt wurden, sondern auch, wie solche Inhalte von TikTok klassifiziert und gekennzeichnet werden. Insbesondere die Klassifizierung über sogenannte Diversifizierungslabels kann weiter darüber Aufschluss geben, warum bestimmte parteipolitische Inhalte ausgewählt und verarbeitet werden.

Der Digital Services Act (DSA) verpflichtet sehr große Online-Plattformen wie TikTok dazu, mindestens einmal jährlich „alle tatsächlichen oder absehbaren nachteiligen Auswirkungen auf die gesellschaftliche Debatte und auf Wahlprozesse und die öffentliche Sicherheit“ (Art. 34 (1c) DSA) zu bewerten und dabei auch die Gestaltung der Empfehlungssysteme zu berücksichtigen. Das Ziel dieser Kurzanalyse ist es daher, einen unabhängigen Forschungsbeitrag zur Bewertung und Minderung systemischer Risiken für Wahlprozesse zu liefern und gleichzeitig zur methodologischen Entwicklung beizutragen. Die Analyse stützt sich dabei auf einen Datensatz, der anhand von manuell trainierten Accounts sowie sogenannten „Sockenpuppen-Accounts” (Zweit- oder Mehrfachaccounts) im Vorfeld der Bundestagswahl 2025 erstellt wurde. Im Folgenden werden die Methodik, die zentralen Analyseergebnissen und konkrete Handlungsempfehlungen präsentiert.

Die Ergebnisse der Auswertung von 22.477 TikTok-Beiträgen, die im Vorfeld der Bundestagswahl 2025 mit 13 Accounts erhoben wurden, zeigen:

Für das Erstellen des Datensatzes wurde ein Persona-basierter-Ansatz gewählt. Dazu wurden in einem ersten Schritt zehn Personas entwickelt, die alle in Deutschland verortet sind, jedoch unterschiedlichen Altersgruppen angehören und sich in Geschlecht und Interessen unterscheiden. Zusätzlich wurde jede Persona politisch positioniert. Um die politischen Interessen möglichst genau abbilden zu können, wurde ein zweidimensionales Konfliktlinienmodell genutzt, welches sich an sozio-ökonomischen sowie sozio-kulturellen Konflikten orientiert. Die sozio-ökonomische Konfliktlinie bezieht sich auf verteilungsbezogene Konflikte wie Marktfreiheit im Gegensatz zu sozialer Gleichheit. Die sozio-kulturelle Konfliktlinie beschreibt wertebezogene Konflikte, genauer liberale Haltungen wie „Multikulturalität” im Gegensatz zu konservativen oder autoritären Haltungen wie „Ordnungsdenken” oder „übertriebener Nationalstolz”. Für die zehn Personas wurden fünf politische Positionen gewählt und je zwei der Accounts zugeteilt.

Die für jede Persona angelegten Accounts haben die Forscher*innen manuell im Zeitraum 13.01.2025 bis 24.01.2025 trainiert. Dabei haben sie die politische Einordnung sowie vorgegebenen Interessen genutzt, um während des Trainings zu entscheiden, ob ein Video angeschaut oder übersprungen wird. Die durchschnittliche Trainingszeit pro Tag betrug dabei 19,6 Minuten. Dabei wurden gezielt Videos angeschaut, die den Interessen und der politischen Ausrichtung der Persona entsprechen, um den Für-dich-Feed so zu „trainieren“, dass er Videos anzeigt, die für die jeweilige Persona interessant sind. Um das Empfehlungssystem nicht durch die Forschung zu beeinflussen, beispielsweise durch das Notieren von Beobachtungen, führten die Forscher*innen das Training in Sequenzen durch. Dazwischen wurden Auffälligkeiten dokumentiert. Die Daten aus den verschiedenen Accounts wurden anschließend über den Datenexport von TikTok extrahiert. Zusätzlich wurden drei Accounts erstellt, die automatisiert in dem Trainingszeitraum ohne politische Positionierung durch den Für-Dich-Feed gescrollt sind.

In einem weiteren Schritt wurden die Metadaten der einzelnen Videos erhoben, indem der Aufrufverlauf extrahiert wurde. Dieser enthält neben der Videobeschreibung inklusive Hashtags auch inhaltliche Klassifizierungen, die für die Nutzer*innen nicht sichtbar sind. Diese Diversifizierungslabels, die auch politische Inhalte als solche kennzeichnen, könnten eine wichtige Rolle dabei spielen, welche Inhalte den Nutzer*innen vorgeschlagen werden.

Für die folgende Analyse wurde der Datensatz von 22.477 TikTok-Beiträgen auf diejenigen reduziert, die entweder von einem offiziellen Account von Politiker*innen stammen, den Namen der Partei im Accountnamen enthalten oder die Parteien in der Videobeschreibung erwähnen. Die Analyse bezieht sich dabei auf Parteien, die im Bundestag vertreten sind, oder derzeit nah an der 5%-Hürde liegen. Auf Grundlage einer Stichwortsuche mit den Parteinamen wurde eine Accountliste erstellt, die zwei Forscher*innen manuell kodiert haben. Dabei wurde zwischen offiziellen Parteiaccounts und Fanpages unterschieden. Zu offiziellen Parteiaccounts zählen Accounts von Kandidat*innen für die anstehende Bundestagswahl, bereits gewählte Politiker*innen auf Kommunal-, Landes-, und Bundesebene, die Accounts der Jugendverbände, sowie die Accounts der Parteiverbände. Zu den Fanpages zählen wiederum Accounts, die keine offiziellen Parteiaccounts sind, aber in dem Profilbild des Accounts das Parteilogo enthalten, größtenteils Inhalte der Parteien (wieder-)veröffentlichen oder ihre Unterstützung einer Partei ausdrücklich in der Kurzbeschreibung des Accounts zum Ausdruck bringen. Auf diese Weise konnten 3.246 Inhalte Parteien und weitere 1.464 Inhalte Fanpages zugeordnet werden.

Ein Großteil der Videos, die den Personas ausgespielt wurden, enthielten keine parteipolitischen Inhalte, was der Selbstdarstellung von TikTok als Unterhaltungsplattform entspricht. Dennoch wurden allen Personas im Laufe des Trainings parteipolitische Inhalte ausgespielt. Diese Inhalte entsprachen in der Summe größtenteils der politischen Positionierung der Personas. So wurden Personas, die soziokulturell liberal und sozioökonomisch links positioniert waren größtenteils Inhalte der Partei Die Linke ausgespielt. Personas, die libertär mittig und sozioökonomisch rechts positioniert waren, wurden wiederum eher Inhalte der Parteien CDU/CSU sowie der FDP ausgespielt. Es ist anzumerken, dass allen Accounts auch Inhalte von Parteien ausgespielt wurden, die nicht ihrer politischen Orientierung entsprachen. Die ausgespielten Inhalte stammten dabei von mindestens vier verschiedenen Parteien, bei sechs Personas sogar von allen sieben untersuchten Parteien.

Wahlbezogene Inhalte häufig nicht als solche gekennzeichnet

Laut TikToks Schutzmaßnahmen für die Bundestagswahl 2025 sollen wahlbezogene Videos, LIVEs und Suchanfragen mit Labels gekennzeichnet werden (Abbildung 1), die auf TikToks Wahlinformationsseite verlinken. Diese Seite enthält wiederum weiterführende Links, etwa zur offiziellen Informationsseite der Bundeswahlleiterin sowie dem dazugehörigen TikTok-Account.

Abbildung 1: Beispiel für ein mit Label gekennzeichnetes Video

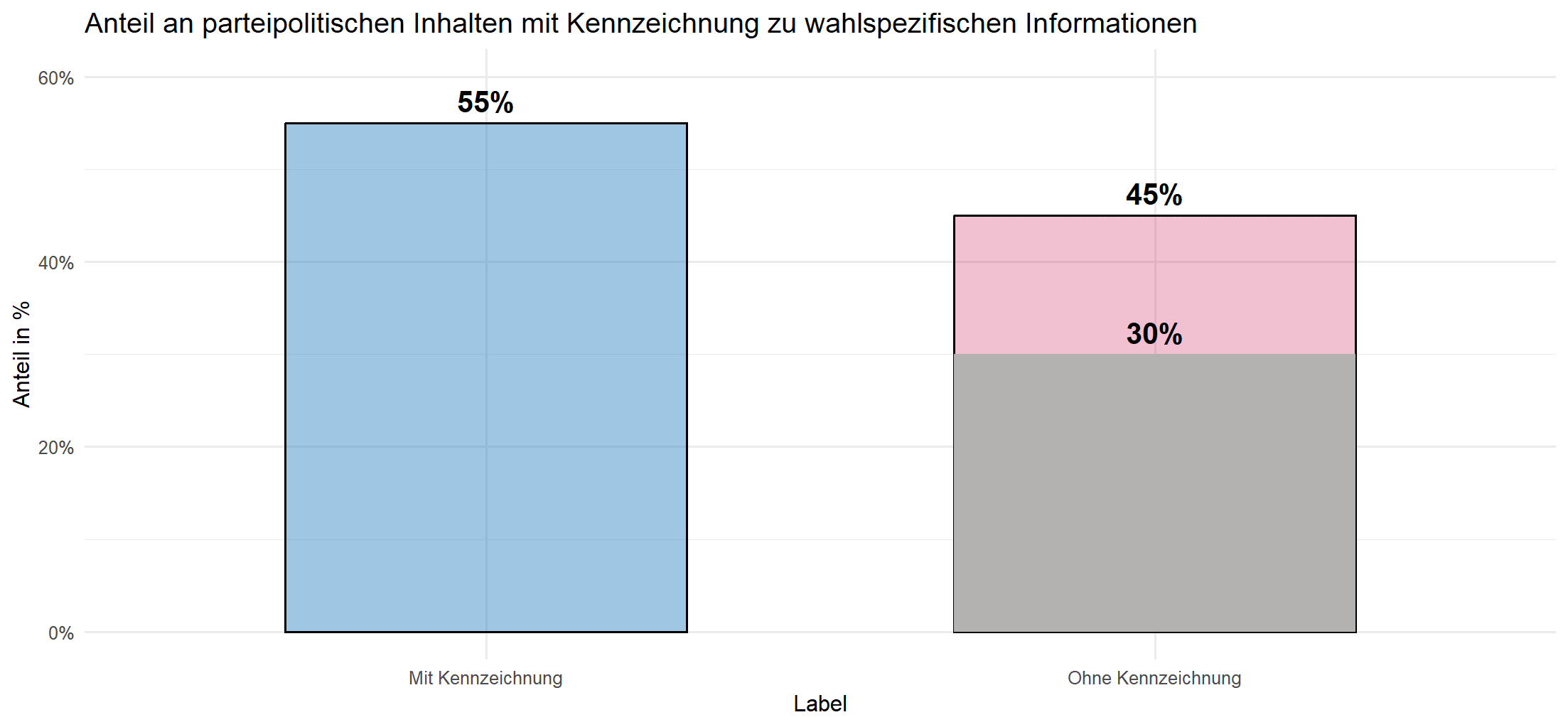

Die durchgeführte Analyse von Inhalten offizieller Accounts sowie Fanpages ergibt, dass nur 55% der Videos, die von einem offiziellen Parteiaccount oder einer Fanpage stammen, als wahlbezogener Inhalt gekennzeichnet sind (Abbildung 2). Ein Grund für den hohen Anteil an nicht-gekennzeichneten Videos mit wahlbezogenen Inhalten könnte darin liegen, dass in der Trainingsphase im Januar noch Videos ausgespielt wurden, die vor dem 20. Dezember 2024 – der Zeitpunkt der Bekanntgabe von TikToks Schutzmaßnahmen – veröffentlicht wurden und dementsprechend keine Kennzeichnung erhalten hatten. Doch von den 45% der nicht gekennzeichneten Inhalte sind dennoch 30% (637) nach dem 20. Dezember 2024 veröffentlicht worden.

Abbildung 2: Anteil parteipolitischer Inhalte mit Label

Die Ursache für die Defizite bei der Kennzeichnung wird aus der Analyse der vorhandenen Parameter nicht ersichtlich. Es gibt keine Anzeichen dafür, dass die Inhalte der verschiedenen Parteien beeinflussen, ob Inhalte gekennzeichnet werden oder nicht. Außerdem stammen viele der Inhalte von verifizierten Accounts, darunter Accounts von Olaf Scholz (teamolafscholz), Sarah Wagenknecht (sahra.wagenknecht) oder Cem Özdemir (cem.oezdemir). Fast alle der Videos verfügen über Beschreibungstexte, in denen in den meisten Fällen mindestens eine Partei genannt wird. Zudem verfügt ein Großteil der Videos über einen Originalsound mit der Stimme der Politiker*innen. So sind beispielsweise 14 Videos des offiziellen Accounts des Politikers Bodo Ramelow (Die Linke) nicht mit einem Banner versehen, enthalten aber ausschließlich Originalsound und erwähnen in allen Fällen den offiziellen Pateiaccount in der Videobeschreibung.

AfD-Inhalte überproportional häufig als erstes ausgespielt

Während es in der Kennzeichnung wahlbezogener Inhalte keine nennenswerten Unterschiede zwischen den Parteien gibt, unterscheidet sich die Präsenz der Parteien innerhalb der ersten fünf ausgespielten parteipolitischen Inhalte erheblich. So wurden beim Trainieren der Accounts 9 von 13 Accounts und damit mehr als zwei Drittel als erster Beitrag mit parteipolitischem Bezug ein AfD-Inhalt ausgespielt, gefolgt von Inhalten der SPD in 3 von 13 Accounts. Bei den ausgespielten AfD-Inhalten handelt es sich dabei ausschließlich um Inhalte von Fanpages, während die Inhalte der anderen Parteien überwiegend von offiziellen Parteiaccounts stammen. Insgesamt sind innerhalb der ersten fünf parteipolitischen Inhalte der 13 Accounts (n=65) 49% von offiziellen AfD-Accounts oder -Fanpages. Zum Vergleich: es folgt SPD mit 20%, dann Die Linke (11%), BSW (9%), CDU/CSU (6%), Bündnis 90/Die Grünen (3%) und FDP (1,5%). Auffällig ist zudem, dass bei den drei unpolitischen, automatisierten Accounts, die ausschließlich scrollen und keine politische Positionierung aufweisen, von den insgesamt 15 ausgespielten Inhalten 11 von AfD-Fanpages stammen (Abbildung 3).

Abbildung 3: Inhalte innerhalb der ersten 5 parteipolitischen Videos

Dieses Ergebnis verändert sich auch nicht, wenn alle ausgespielten Inhalte berücksichtigt werden. Zwar ist die Anzahl der Inhalte bis zum ersten parteipolitischen Inhalt zwischen den Parteien im gesamten Feed breit gestreut. Die Betrachtung des Medianwerts für das erste ausgespielte Video von Fanpages und offiziellen Accounts verdeutlicht aber, dass Inhalte von AfD-Fanpages im Median als erstes ausgespielt werden, nämlich nach 113 Videos, was im vorliegenden Fall einer Nutzungsdauer der Online-Plattform von ungefähr elf Minuten entspricht. Am zweithäufigsten werden Inhalte offizieller Parteiaccounts der SPD ausgespielt, gefolgt von Inhalten offizieller Parteiaccounts der AfD (Abbildung 4). Am spätesten werden Inhalte der der offiziellen Parteiaccounts der CDU/CSU ausgespielt, mit einem Medianwert von 731 Videos.

Abbildung 4: Ausspielung parteipolitischer Inhalte im Feed

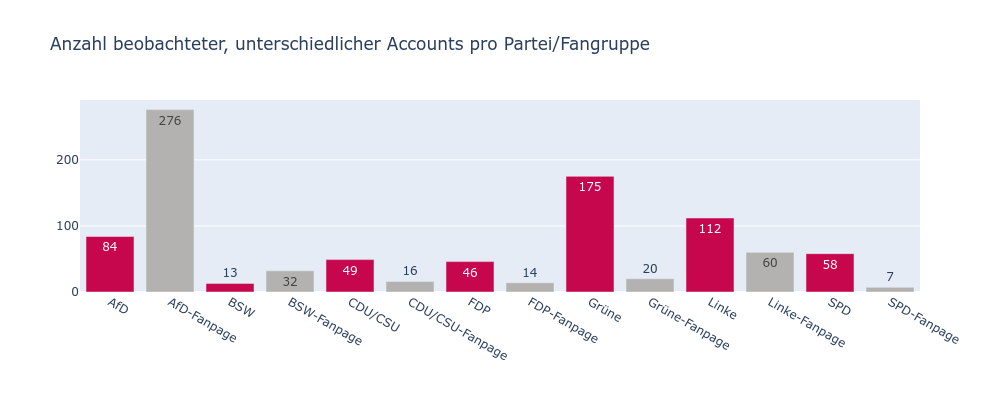

Die hohe Anzahl an AfD-Fanpages in den ersten fünf ausgespielten parteipolitischen Inhalten kann zum Teil mit der hohen Anzahl an AfD-Fanpages erklärt werden, die in dem vorliegenden Datensatz identifiziert wurden. Insbesondere im Vergleich zu den anderen Parteien wird deutlich, dass die AfD mit 276 Fanpages eine besonders hohe Präsenz bei allen beobachteten parteipolitischen Accounts hat (Abbildung 5). Die Linke weist immerhin noch 60 Fanpages auf und BSW 34 Fanpages. Bündnis 90/Die Grünen und Die Linke haben wiederum mit 175, beziehungsweise 112 verschiedenen offiziellen Accounts sehr aktive Parteistrukturen auf TikTok.

Abbildung 5: Anzahl der Accounts pro Partei/Fangruppe (n=962)

Parteipolitische Inhalte vielfach nicht als „politisch” klassifiziert

Das auffällig häufige Ausspielen von AfD-Inhalten in den ersten Videos der neu angelegten Accounts könnte auf eine asymmetrische Amplifizierung, also eine ungleiche Berichterstattung oder Verstärkung parteipolitischer Inhalte hindeuten. Allerdings konnten wir im weiteren Aufrufverlauf keine signifikanten Unterschiede zwischen den Parteien feststellen, da die Accounts ab einen bestimmten Zeitpunkt überwiegend Inhalte entsprechend ihrer politischen Positionierung erhalten haben.

Aufschluss über die Verteilung von Themen innerhalb des Feeds könnte die Klassifizierung durch sogenannte Diversifizierungslabels von Inhalten durch TikTok geben. Diese Labels werden Videos zugeteilt und sie kategorisieren Inhalte nach Kategorien wie „Society/Politics”, „Society/Social Issues” oder „Entertainment”. Die Diversifizierungslabels sind für die Nutzer*innen nicht direkt sichtbar. Es ist jedoch zu vermuten, dass der Empfehlungsalgorithmus sie zur Gewichtung verschiedener Inhaltskategorien verwendet, um den Nutzer*innen möglichst diverse Inhalte ausspielen zu können. Insgesamt wurden den Accounts Inhalte mit 78 verschiedenen Diversifizierungslabels ausgespielt. Im Weiteren liegt der Fokus jedoch auf der Auswertung der Labels „Society/Politics” und „Society/Social Issues”. Letzteres Label wird in der vorliegenden Analyse ebenfalls als „politisch” eingeordnet.

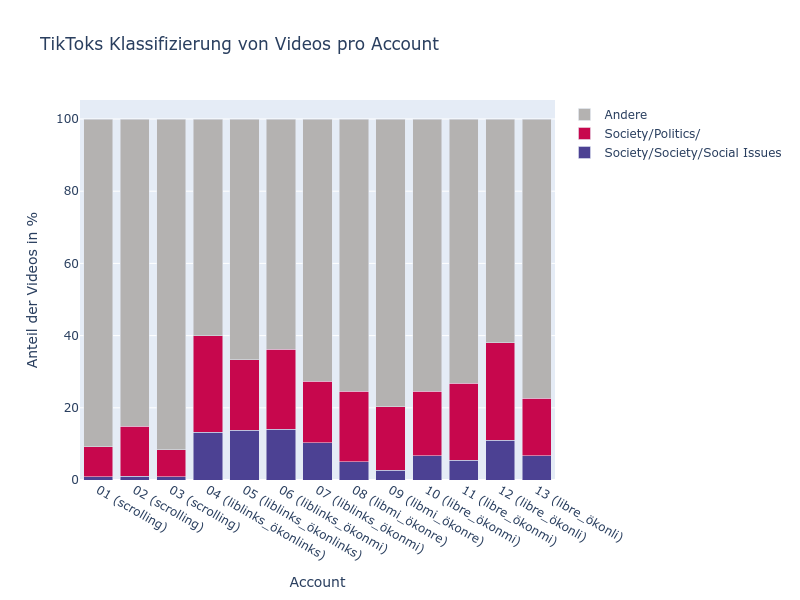

Wie eingangs beschrieben, werden Nutzer*innen von TikTok zu einem großen Teil Unterhaltungsvideos ausgespielt. Wird jedoch der prozentuale Anteil der verschiedenen Diversifizierungslabels in den ausgespielten Inhalten der trainierten Accounts betrachtet, so wird deutlich, dass der Algorithmus eine maximale „Politisierung” von unter einem Drittel der empfohlenen Videos im Für-dich-Feed zulässt (Abbildung 6). So enthält kein Feed der 13 Accounts mehr als 30% von Inhalten mit politischer Klassifizierung.

Abbildung 6: TikToks Klassifizierung von Videos pro Account

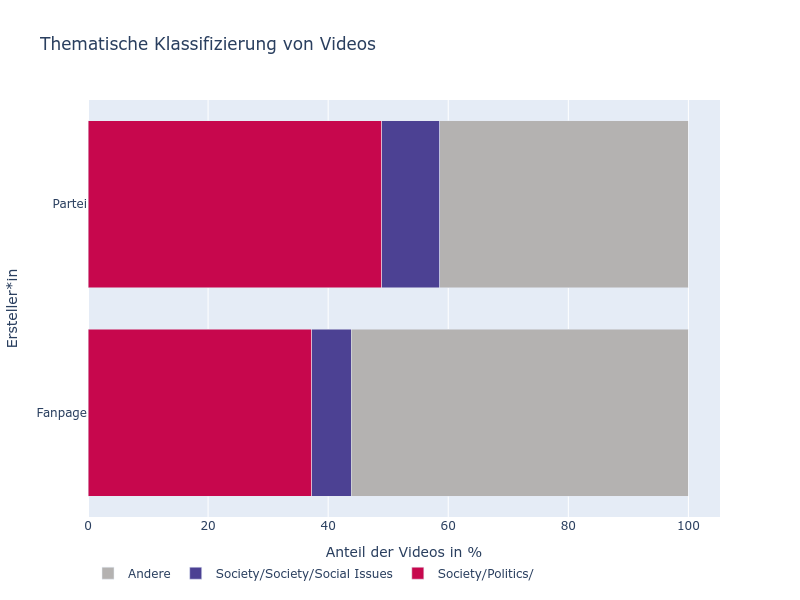

Bei Inhalten, die in der Analyse offiziellen Partei- oder Kandidatenaccounts oder Fanpages zuordnet wurden, wird der Großteil als „Society/Politics”, teils auch als „Society/Societal issue” klassifiziert (Abbildung 7). Gleichzeitig aber werden nur etwa 59% der der Inhalte der offiziellen Accounts von Parteien oder Kandidat*innen als politisch klassifiziert. Bei Fanpages, die Inhalte häufig überspitzter darstellen, werden nur 47% der Videos als politisch klassifiziert.

Abbildung 7: Vergabe der Diversifizierungslabels

Diese aufgezeigte Fehlklassifizierung könnte zu einer asymmetrischen Amplifizierung bestimmter parteipolitischer Inhalte beigetragen haben, da die Nutzer*innen dadurch wesentlich mehr als die von uns vermutete Obergrenze für politische Inhalten von 30% empfohlen bekommen haben könnten. Auf welche Inhaltsmerkmale sich die Klassifizierung bezieht oder wie sich diese konkret auf die Amplifizierung auswirkt ist zum jetzigen Zeitpunkt noch unklar und Gegenstand der weiteren Forschung von AHEAD.tech.

Zudem konnte in der vorliegenden Analyse nur eine Untermenge der Inhalte in den Für-dich-Feeds der Personas berücksichtigt werden, die auf Basis von Hashtags in den Accountnamen und der Videobeschreibung für die manuelle Kodierung vorausgewählt wurden. In einer weiterführenden Analyse sollen auch die parteipolitischen Inhalte berücksichtigt werden, die mit der verwendeten Methode nicht identifiziert werden konnten. Diese könnten zusätzliche Hinweise darüber liefern, weshalb bestimmte parteipolitische Inhalte als „politisch” klassifiziert werden und andere nicht. Auch könnte eine Erweiterung der Datenbasis gegebenenfalls weitere Erkenntnisse zu den fehlenden Wahlinformationslabeln liefern.

Wie eingangs dargestellt, schreibt der DSA den sehr großen Online-Plattformen wie TikTok eine Bewertung von Risiken unter anderem für die gesellschaftliche Debatte, Wahlprozesse und öffentliche Sicherheit vor. Darüber hinaus sind diese verpflichtet, angemessene, verhältnismäßige und wirksame Risikominderungsmaßnahmen zu ergreifen. Dazu werden unter Art. 35 (1) DSA nicht abschließende Maßnahmen aufgelistet, einschließlich der Erprobung und Anpassung der algorithmischen Systeme. Welche konkreten Maßnahmen jedoch umgesetzt werden, obliegt – ebenso wie die Interpretation der DSA-Risikokategorien selbst – weitgehend den Online-Plattformen. Als Anhaltspunkt hat die Europäische Kommission Leitlinien der Kommission zur Minderung systemischer Risiken in Wahlprozessen herausgegeben. Diese sind nicht verpflichtend, stellen jedoch Vorgaben als Best-Practices dar.

Identifizierung von Lücken im Kennzeichnungssystem

Zu diesen Best-Practices gehört unter anderem die „eindeutige, gut sichtbare und nicht täuschende Kennzeichnung von offiziellen Konten und von Konten, die verlässliche Informationen über den Wahlprozess bereitstellen.“ Als Teil der Maßnahmen zur Bundestagswahl 2025 kennzeichnet TikTok auf Inhaltsebene mindestens seit dem 20. Dezember 2024 wahlbezogene Videos LIVEs und Suchanfragen mit Labels.

Die Ergebnisse der vorliegenden Analyse zeigen jedoch erhebliche Inkonsistenzen auf. So waren 45% der Videos, die von einem offiziellen Parteiaccount oder einer Fanpage stammen, sind nicht mit einem Hinweis auf wahlbezogene Informationen gekennzeichnet. Spezifische Muster und Ursachen für die identifizierte Nicht-Kennzeichnung konnten – außer einem vermuteten Zusammenhang mit dem Zeitpunkt der Bekanntgabe von TikToks Schutzmaßnahmen – im Kontext limitierter Forschungsressourcen nicht herausgearbeitet werden. Eine Untersuchung zur Bundestagswahl 2021 stellte jedoch bereits Probleme bei der Kennzeichnung fest, was auf die Verwendung einzelner Schlüsselwörter und Hashtags in der automatisierten Erkennung zurückgeführt wurde. Aus TikToks eigenen Angaben geht nicht hervor, welche Videos als „wahlbezogen” einstuft und welche nicht. Darüber hinaus bleibt unklar, wie genau TikTok die Kennzeichnungen umsetzt und ob die Kennzeichnungen von Inhaltemoderator*innen überprüft werden. Folglich ist es abschließend nicht möglich zu beurteilen, warum insbesondere die Kennzeichnung offizieller Partei-Accounts unzureichend ist.

In diesem Kontext sollte TikTok folgende Handlungen umsetzen:

Mehr Transparenz bei der Klassifizierung von parteipolitischen Inhalten

Die Leitlinien zur Minderung systemischer Risiken für Wahlprozesse heben außerdem die wichtige Rolle der Empfehlungssysteme bei der öffentlichen Meinungsbildung hervor und empfehlen, dass diese „so konzipiert und angepasst werden, dass die Nutzer eine sinnvolle Auswahl und Kontrolle in Bezug auf ihre Nachrichten- und Meinungsquellen” haben. Zudem sollen „Maßnahmen zur Gewährleistung der Transparenz hinsichtlich der Gestaltung und Funktionsweise von Empfehlungssystemen, insbesondere in Bezug auf die Daten und Informationen, die bei der Gestaltung von Systemen, die Medienpluralismus und inhaltliche Vielfalt fördern sollen, verwendet werden”. Dadurch sollen wiederum „eine Kontrolle und Untersuchung durch Dritte” erleichtert werden.

Trotz dieser Best-Practices hat die Analyse ergeben, dass AfD-Inhalte überproportional häufig als erstes in den Für-dich-Feeds ausgespielt wurden. Da TikTok ab der ersten Interaktion mit den Videos die potenzielle Inhalte-Relevanz für die Nutzer*innen misst, könnte das frühe Ausspielen von AfD-Inhalten deren Präsenz im gesamten Für-dich-Feed begünstigt haben. Desweiteren könnte die Tatsache, dass Inhalte von Fanpages häufiger nicht als „politisch“ klassifiziert wurden als Inhalte von Partei-Accounts, zur erhöhten Sichtbarkeit beigetragen haben.

Um umfassend nachvollziehen zu können, inwiefern diese Annahmen tatsächlich zutreffen, ist Zugang zu Daten und Informationen über die Gestaltung von Systemen notwendig, die inhaltliche Vielfalt fördern sollen. Die derzeit bereitgestellten Informationen sind nicht ausreichend. Laut Angaben von TikTok soll zusätzlich zur Ähnlichkeitsprüfung eine Diversifizierung im Für-dich-Feed verhindern, dass den Nutzer*innen zu viele Inhalte aus einer Kategorie, die akkumuliert problematisch sind, ausgespielt werden. Wie konkret TikTok versucht, die Inhalte im Feed zu diversifizieren und, ob auch parteipolitische Inhalte zu den umfassten Themen gehören, wird nicht erklärt. So gibt es keine Auskünfte über die Bestimmung und Gewichtung einzelner Diversifizierungslabels. Dadurch ist es nicht möglich, zu beurteilen, warum die in dieser Analyse festgestellten Inkonsistenzen bei der Klassifizierung parteipolitischer Inhalte existieren und welchen Einfluss dies auf den Für-dich-Feed hat. Eine allgemeine Analyse der Diversifizierungslabels ist derzeit nur über einen Persona-basierten-Ansatz mit anschließendem Datenscraping möglich. TikToks eigene Datenzugänge umfassen keine entsprechenden Daten. Diese wären jedoch notwendig, um Evidenzen für die Funktionsweise und Wirksamkeit von Anpassungen der Empfehlungssysteme auszubauen und konkrete Interventionen zu entwickeln.

In diesem Kontext sollte TikTok folgende Handlungen umsetzen:

Ausweitung der ermittelten Risiken

Neben Anforderungen an die inhaltliche Vielfalt und Transparenz existieren auch Best-Practices für die Durchführung der DSA-Risikobewertungen selbst. So soll eine „regelmäßige Bewertung der Leistung und der Auswirkungen von Empfehlungssystemen und Behandlung neu auftretender Risiken oder Probleme im Zusammenhang mit Wahlprozessen” stattfinden.

Ein Blick auf den DSA Risk Assessment Report 2023 zeigt, dass das TikTok Elections Integrity Programme Team im Vorfeld von Wahlen zwar Stichproben von wahlbezogenen Inhalten durchführt, um Risiken zu erkennen. Außerdem werden Nutzer*innen Tools bereitstellt, um die im Für-dich-Feed angezeigten Inhalte zu diversifizieren; zu verstehen, warum Videos empfohlen wurden; zu wählen, dass ihnen bestimmte Schlüsselwörter nicht angezeigt werden; und ihren Für-dich-Feed zurückzusetzen. Konkrete Angaben zu den Auswirkungen von Empfehlungssystemen auf die Risiken für Wahlprozesse finden sich hingegen nicht. Darüber hinaus liegt der Fokus der Bewertung gänzlich auf wahlbezogener Fehlinformation. Risiken, die von der asymmetrischen Amplifizierung parteipolitischer Inhalte unterschiedlicher Wahlkandidat*innen ausgehen, oder vorsätzliche Manipulation durch möglicherweise unauthentische Fan-Accounts – einschließlich der Frage, wie Inhalte dieser Accounts vom Für-dich-Feed ausgewählt und verarbeitet werden – bleiben unberücksichtigt.

In diesem Kontext sollte TikTok folgende Handlungen umsetzen:

Amman | Berlin | London | Paris | Washington DC | Toronto

Copyright © Institute for Strategic Dialogue (). Das Institute for Strategic Dialogue (gGmbH) ist beim Amtsgericht Berlin-Charlottenburg registriert (HRB 207 328B). Die Geschäftsführerin ist Sarah Kennedy. Die Anschrift lautet: Postfach 80647, 10006 Berlin. Alle Rechte vorbehalten.

Diese Seite verwendet Cookies. Mit der Weiternutzung der Seite, stimmst du die Verwendung von Cookies zu.

Einstellungen akzeptierenVerberge nur die BenachrichtigungEinstellungenWir können Cookies anfordern, die auf Ihrem Gerät eingestellt werden. Wir verwenden Cookies, um uns mitzuteilen, wenn Sie unsere Websites besuchen, wie Sie mit uns interagieren, Ihre Nutzererfahrung verbessern und Ihre Beziehung zu unserer Website anpassen.

Klicken Sie auf die verschiedenen Kategorienüberschriften, um mehr zu erfahren. Sie können auch einige Ihrer Einstellungen ändern. Beachten Sie, dass das Blockieren einiger Arten von Cookies Auswirkungen auf Ihre Erfahrung auf unseren Websites und auf die Dienste haben kann, die wir anbieten können.

Diese Cookies sind unbedingt erforderlich, um Ihnen die auf unserer Webseite verfügbaren Dienste und Funktionen zur Verfügung zu stellen.

Da diese Cookies für die auf unserer Webseite verfügbaren Dienste und Funktionen unbedingt erforderlich sind, hat die Ablehnung Auswirkungen auf die Funktionsweise unserer Webseite. Sie können Cookies jederzeit blockieren oder löschen, indem Sie Ihre Browsereinstellungen ändern und das Blockieren aller Cookies auf dieser Webseite erzwingen. Sie werden jedoch immer aufgefordert, Cookies zu akzeptieren / abzulehnen, wenn Sie unsere Website erneut besuchen.

Wir respektieren es voll und ganz, wenn Sie Cookies ablehnen möchten. Um zu vermeiden, dass Sie immer wieder nach Cookies gefragt werden, erlauben Sie uns bitte, einen Cookie für Ihre Einstellungen zu speichern. Sie können sich jederzeit abmelden oder andere Cookies zulassen, um unsere Dienste vollumfänglich nutzen zu können. Wenn Sie Cookies ablehnen, werden alle gesetzten Cookies auf unserer Domain entfernt.

Wir stellen Ihnen eine Liste der von Ihrem Computer auf unserer Domain gespeicherten Cookies zur Verfügung. Aus Sicherheitsgründen können wie Ihnen keine Cookies anzeigen, die von anderen Domains gespeichert werden. Diese können Sie in den Sicherheitseinstellungen Ihres Browsers einsehen.

Diese Cookies sammeln Informationen, die uns - teilweise zusammengefasst - dabei helfen zu verstehen, wie unsere Webseite genutzt wird und wie effektiv unsere Marketing-Maßnahmen sind. Auch können wir mit den Erkenntnissen aus diesen Cookies unsere Anwendungen anpassen, um Ihre Nutzererfahrung auf unserer Webseite zu verbessern.

Wenn Sie nicht wollen, dass wir Ihren Besuch auf unserer Seite verfolgen können Sie dies hier in Ihrem Browser blockieren:

Sie können unsere Cookies und Datenschutzeinstellungen im Detail in unseren Datenschutzrichtlinie nachlesen.

Datenschutzerklärung